Medische knowhow voor astronauten dankzij toegevoegde realiteit

Een nieuw door ESA ontwikkeld systeem voor zogenaamde toegevoegde realiteit geeft astronauten ogenblikkelijk medische knowhow. Daarvoor moeten ze alleen maar een helm met een display op hun hoofd plaatsen. Het prototype werd in België ontwikkeld en getest.

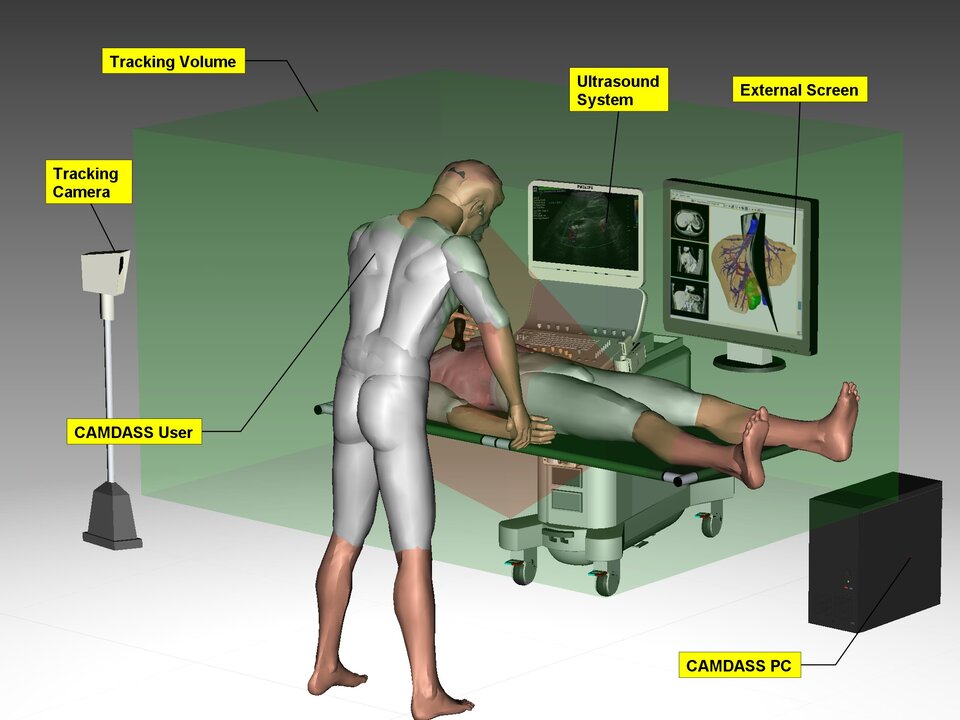

Het Computer Assisted Medical Diagnosis and Surgery System (CAMDASS) is een draagbaar prototype voor toegevoegde realiteit.

Bij toegevoegde realiteit (TR) worden virtuele en werkelijke realiteit vermengd door met computers gegenereerde grafieken te combineren met wat de drager van het systeem werkelijk ziet.

CAMDASS wordt momenteel gebruikt bij ultrasoon onderzoek, maar kan in principe ook bij andere procedures worden gebruikt.

Het ultrasoon onderzoek bijt de spits af omdat het een veelzijdig en efficiënt middel is om medische diagnoses te stellen en omdat het al beschikbaar is aan boord van het internationaal ruimtestation ISS, dat in een baan rond de aarde draait.

Maar in de toekomst zullen astronauten zich nog verder in de ruimte wagen en zullen ze nog veel meer voor zichzelf moeten zorgen.

Bij het contact met de aarde treedt er immers een vertraging van verschillende minuten op (hoe lang precies hangt af van de afstand tot de aarde) en soms zal er zelfs helemaal geen contact met de aarde mogelijk zijn.

'Hoewel bemanningen over een zekere medische expertise zullen beschikken is het onmogelijk ruimtevaarders op te leiden voor alle medische procedures die eventueel nodig zijn', zegt Arnaud Runge die als biomedisch ingenieur voor ESA aan het hoofd staat van het project.

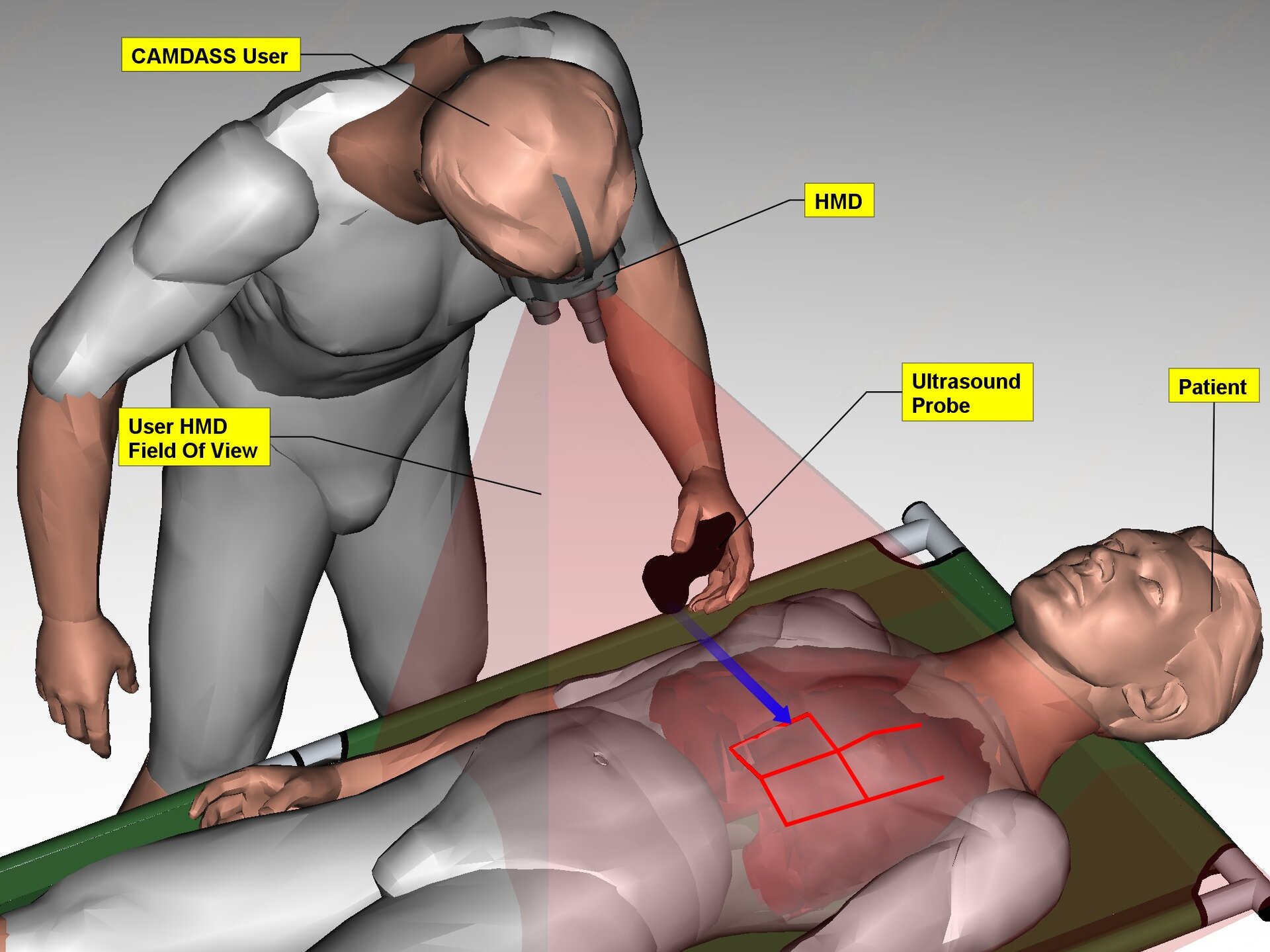

CAMDASS maakt gebruik van een op het hoofd gemonteerde 'helm' met een stereodisplay en een ultrasoon apparaat, gevolgd met een infrarode camera. De patiënt wordt opgevolgd via merktekens die worden aangebracht op de plaats die men wil onderzoeken.

Een ultrasoon diagnoseapparaat wordt met CAMDASS verbonden en het systeem maakt het mogelijk dat het lichaam van een patiënt 'geregistreerd' wordt voor de camera, terwijl het display gecalibreerd wordt op het beeld dat de drager van het toestel werkelijk ziet.

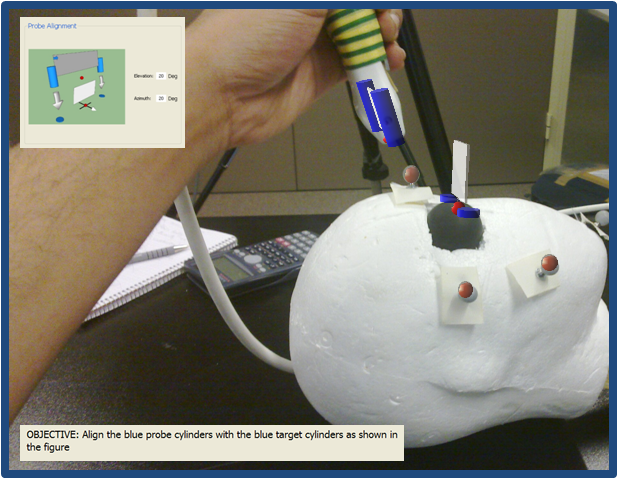

De driedimensionale informatie van de toegevoegde realiteit wordt vervolgens op het scherm van de helm getoond zodat ze de gebruiker kunnen leiden. Ze komt tot stand door punten op een virtueel 'menselijk wezen' en de onderzochte patiënt te laten samenvallen.

Op die manier kan de drager van het systeem het ultrasoon apparaat in de juiste positie brengen en ook doen bewegen.

Ultrasone beelden die als referentie worden gebruikt geven gebruikers een aanwijzing van wat ze zouden moeten zien en dankzij spraakherkenning kan er hands-free worden gewerkt.

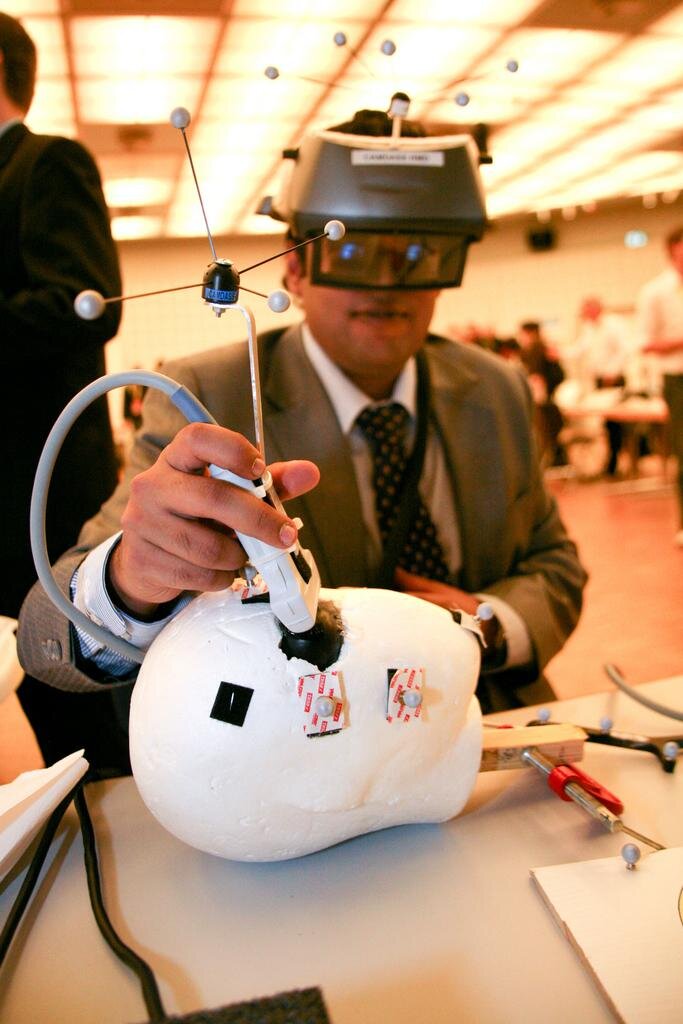

Het prototype werd op zijn bruikbaarheid getest in het UMC Sint-Pieter in Brussel. Daarbij waren studenten geneeskunde en verpleging, het Belgische Rode Kruis en paramedisch personeel van de partij.

Vrij onervaren gebruikers vonden dat ze een behoorlijk moeilijke procedure toch konden uitvoeren zonder bijkomende hulp en dat ze de sonde gemakkelijk in positie konden brengen.

'Gebaseerd op die ervaring willen we het systeem nog verfijnen. Zo willen we bijvoorbeeld het gewicht van het op het hoofd gemonteerde display verkleinen, evenals de algehele omvang van het prototype', aldus Arnaud.

'Eens het systeem volledig ontwikkeld is kan het gebruikt worden als onderdeel van een systeem voor telegeneeskunde voor het verlenen van medische assistentie via satelliet in afgelegen gebieden.'

'Het kan ook gebruikt worden als een autonoom systeem bij noodsituaties. Het zou interessant zijn om meer proeven uit te voeren in afgelegen gebieden, in ontwikkelingslanden en mogelijk in de basis Concordia op Antarctica. Uiteindelijk kan het ook in de ruimte worden gebruikt.'

Gefinancierd door ESA's Basic Technology Research Programme werd het prototype voor de ruimtevaartorganisatie ontwikkeld door een consortium onder leiding van Space Applications Services NV in Zaventem met ondersteuning van de Technische Universität München en het Deutsches Krebsforschungszentrum DKFZ (Duits Onderzoekscentrum voor Kanker).